瑞芯微 RK1820/RK1828 AI 协处理器 RKNN3 SDK V1.0.0 正式版发布, 完美适配 RK3588/RK3576+RK1820/RK1828 硬件组合,为端侧 AI 模型部署提供全栈式软件支撑,在性能、模型适配、功能、精度上全方位升级,兼具高性能、高适配、高能耗比优势。

本次 SDK 覆盖 PC 端开发套件、板端运行 API、模型转换部署示例,支持 Android/Linux 系统,PCIe/USB 高速接口实现低延迟数据交互;核心功能优化亮点突出:

推理效率升级:支持数据传输与推理并行,优化核心算子,多核多模型同时推理适配高并发;

大模型适配更强:支持 mRoPE、Function Call,兼容主流大模型特性;

开发部署更便捷:支持连板精度分析,提供 Python API 轻量化工具包,协处理器可自定义模型后处理,rkllm3 server 新增 embedding 模型支持。

核心性能跃升!LLM 解码效率提升超 15%,3B 破百且最高支持 8B

本次 SDK 正式版的核心突破之一,便是LLM Decode 性能整体提升超过 15%,针对 0.5B-8B 不同参数量级 LLM 模型完成深度适配优化,RK1820/RK1828 根据算力特性做差异化适配,可满足不同端侧场景的 LLM 推理需求。

测试数据显示,RK182X 在轻量型 LLM 模型上的性能表现尤为亮眼,3B 量级模型实现了 Decode TPS 破百的关键突破,Qwen2.5-3B 模型 Decode TPS 达 102.01,为端侧实时大模型交互提供了高效支撑;极致轻量的 Qwen2.5-0.5B 模型同样表现出色,TTFT 仅 21.89ms、TPOT 4.63ms、Decode TPS 215.86;中大型 LLM 模型方面,Qwen3-8B 在 RK1828 上实现稳定推理,Decode TPS 达 61.11,可充分满足端侧中大型 LLM 的部署需求。

*不同参数量 LLM 模型在 RK182X 上的核心性能数据如下:

VLM 模型性能:多模态推理高效稳定

在相同标准测试环境下,RK182X 对多款主流 VLM 及全模态模型完成深度推理优化,RK1820/RK1828 根据算力特性实现差异化适配,不同视觉分辨率下均保持稳定的视觉推理耗时,且 LLM 解码端性能高效,其中完美支持 Qwen3-VL 系列模型,Qwen3-VL-4B 的 LLM Decode TPS 接近 90TPS,RK1828 更实现中大型 VLM 模型全协处理器端推理,多模态交互性能表现优异。

*不同 VLM 模型在 RK182X 上的核心性能数据如下:

RK1828 完美适配 Qwen2.5-Omni-3B 全模态模型,实现音视觉 + 语言全链路高效推理,解码 TPS 达 102.63 成功破百;全协处理器端独立完成推理,392*392 视觉分辨率下推理耗时稳定,音频推理仅 98.91ms,多模态处理效率优异。

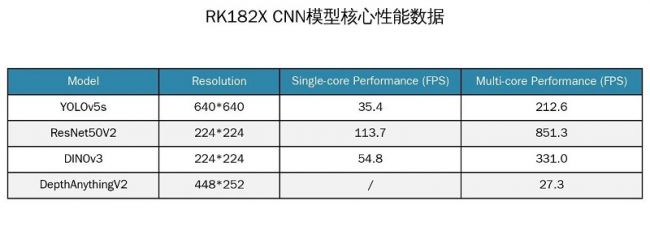

CNN 模型性能:单核算力扎实,多核多 batch 吞吐能力大幅跃升

RK182X 针对经典分类、检测类 CNN 模型完成单核及多 batch 多核推理深度优化,依托多核多模型同时推理的特性充分释放算力,DINOv3 的 ViT 性能表现尤为突出;在保持单核算力稳定的基础上,多batch 多核模式下帧率实现数倍提升,高吞吐特性可高效适配智能监控、工业检测等高并发计算机视觉应用场景,性能与能耗比兼具。

* 不同 CNN 模型在RK182X 上的核心性能数据如下:

精度近乎无损!量化优化做到 “性能升级,精度不丢”

RKNN3 SDK V1.0.0 针对不同类型模型采用差异化量化策略,其中 LLM/VLM 模型采用 W4A16 G32 量化策略,CNN 模型采用 W8A8 量化策略。在大幅提升推理性能的同时,量化后模型精度与原始 float32 版本基本持平,部分模型精度实现反超,有效控制精度损失,真正做到性能升级、效果不减。

全链路模型生态布局 夯实 AIoT2.0感知 - 决策 - 执行能力

RKNN3 SDK V1.0.0 紧扣 AIoT2.0感知 - 决策 - 执行的核心架构,完成超 30 款主流 AI 模型全维度适配,深度联动上下游核心合作伙伴,打通硬件算力、软件栈与算法模型的生态壁垒,模型支持完整、适配效果好,充分释放 RK182X 协处理器的算力价值。

在感知层:多模态数据采集能力拉满,头部伙伴模型深度适配。打造端侧多模态智能数据入口,视觉端全面适配 Mobilenet、YOLO 系列等经典 CNN 视觉模型及深度估计模型;音频端深度联动科大讯飞、思必驰、大象声科等感知层头部伙伴,完成 ASR、TTS 等核心语音模型适配,多模态感知能力高效落地。

在决策层:全规格模型生态闭环,头部厂商核心模型逐一适配。适配 Qwen3-VL、GLM Edge 等主流开源大模型,全兼容 0.5B-8B全规格 LLM 模型,同时深度适配千问 Qwen2.5-Omni-3B、智谱 MiniCPM、阶跃星辰 Step-GUI-Edge 等头部厂商核心模型,全模态智能决策能力端侧高效运行。

在执行层:软硬协同赋能场景落地,适配全链路模型能力转化。依托 RK3588/RK3576+RK182X 软硬件组合,支持协处理器自定义模型后处理,可灵活适配各类模型决策结果执行逻辑;兼容 Android/Linux 系统,让全品类 AI 能力无缝落地到智能硬件、工业检测等多元场景,实现从算法到应用的完整转化。

此外,SDK 全面兼容 Hugging Face、ModelScope、GitHub 等开源平台,用户可直接从Github获取预先转好的 RKNN 模型:

Model Zoo地址:https://github.com/airockchip/rknn3-model-zoo;

工具提取地址:https://github.com/airockchip/rknn3-toolkit;

RK1820/RK1828 RKNN3 SDK V1.0.0 正式版的发布,是瑞芯微在端侧 AI 协处理器领域的重要突破,从性能跃升、模型扩展到精度优化,每一项更新均紧扣开发者实际部署需求,让 RK182X 的高算力、高能耗比优势充分释放。未来,瑞芯微将持续迭代优化 RKNN3 SDK,不断扩展模型支持范围、提升算力表现,打造更高效的端侧 AI 开发工具链,助力更多 AI 创新应用在端侧落地。

瑞芯微市场部邮箱:rkmarketing@rock-chips.com,欢迎各来自五湖四海的AI 伙伴对接交流,携手探索端侧 AI 多场景落地新可能。

访谈

更多护航视频监控网络安全 做物联网安全的守护者 ——专访天防安全总经理段伟恒

在万物互联时代,网络安全的重要性日益凸显,尤其在快速发展的城市建设中,搭建的巨大物联网络对其安全保障…

做行业赋能者 HID迎接数字化浪潮新机遇 破解新挑战

今年3月份,全球可信身份解决方案提供商HID发布了最新的《安防行业现状报告》(以下简称“报告”),该报告…

数字化浪潮下,安防厂商如何满足行业客户的定制化需求?

回顾近两年,受疫情因素影响,包括安防在内的诸多行业领域都遭受了来自市场 “不确定性”因素的冲击,市场…